- românesc

-

EnglishDeutschItaliaFrançais한국의русскийSvenskaNederlandespañolPortuguêspolski繁体中文SuomiGaeilgeSlovenskáSlovenijaČeštinaMelayuMagyarországHrvatskaDanskromânescIndonesiaΕλλάδαБългарски езикGalegolietuviųMaoriRepublika e ShqipërisëالعربيةአማርኛAzərbaycanEesti VabariikEuskeraБеларусьLëtzebuergeschAyitiAfrikaansBosnaíslenskaCambodiaမြန်မာМонголулсМакедонскиmalaɡasʲພາສາລາວKurdîსაქართველოIsiXhosaفارسیisiZuluPilipinoසිංහලTürk diliTiếng ViệtहिंदीТоҷикӣاردوภาษาไทยO'zbekKongeriketবাংলা ভাষারChicheŵaSamoa日本語SesothoCрпскиKiswahiliУкраїнаनेपालीעִבְרִיתپښتوКыргыз тилиҚазақшаCatalàCorsaLatviešuHausaગુજરાતીಕನ್ನಡkannaḍaमराठी

Ce este un NPU și cum funcționează în dispozitivele AI?

Catalog

Ce este un NPU?

O unitate de procesare neuronală (NPU) este un procesor specializat conceput pentru a gestiona sarcinile de inteligență artificială mai eficient decât un procesor de uz general.Rolul său principal este de a accelera operațiunile rețelei neuronale utilizate în funcții precum recunoașterea imaginilor, procesarea vocii, detectarea obiectelor și inferența AI în timp real.Spre deosebire de un procesor, care este construit pentru a gestiona multe sarcini de calcul diferite, un NPU se concentrează pe calculele legate de AI.Este optimizat pentru a procesa cantități mari de date în același timp, făcându-l potrivit pentru sarcini de lucru care necesită recunoaștere rapidă a modelelor și luare a deciziilor.În dispozitivele moderne, NPU-urile ajută funcțiile AI să ruleze direct pe hardware-ul local, în loc să depindă pe deplin de serverele cloud.Acest lucru permite smartphone-urilor, camerelor inteligente, roboților, vehiculelor și dispozitivelor de margine să răspundă mai rapid în timp ce folosesc mai puțină energie.Din acest motiv, NPU-urile au devenit o parte importantă a sistemelor inteligente moderne.

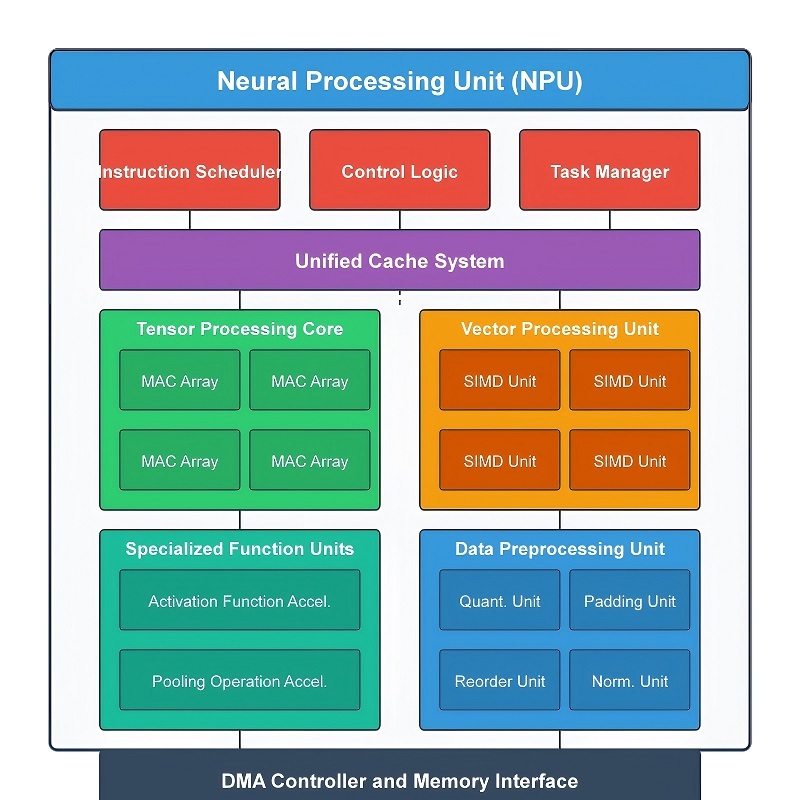

Arhitectura de bază și modulele de procesare ale unui NPU

Un NPU este construit din mai multe module hardware specializate care lucrează împreună pentru a procesa rapid și eficient sarcinile de lucru ale rețelei neuronale.În loc să trimită fiecare operație printr-un procesor de uz general, volumul de lucru este împărțit în blocuri hardware dedicate care procesează continuu datele în paralel.Această structură îmbunătățește viteza de inferență AI, reduce mișcarea inutilă a datelor, scade consumul de energie și ajută la menținerea utilizării eficiente a memoriei.

În timpul procesării AI, datele circulă prin mai multe etape în interiorul procesorului.Datele de intrare intră mai întâi în conducta de calcul, unde sunt executate operații matematice la scară largă.Rezultatele intermediare trec apoi prin procesarea de activare, accelerarea tensorului, operațiunile legate de imagine și hardware-ul de optimizare a memoriei înainte ca rezultatul final să fie produs.Deoarece aceste module funcționează împreună într-o secvență coordonată, NPU poate menține un randament ridicat chiar și atunci când rulează modele mari de rețele neuronale.

Module de calcul și activare de bază

Principalul motor de calcul din interiorul unui NPU este unitatea Multiply-Accumulate (MAC).Majoritatea sarcinilor de lucru ale rețelelor neuronale efectuează în mod repetat multiplicarea și adăugarea în seturi de date foarte mari, astfel încât acest hardware gestionează majoritatea calculelor AI în timpul inferenței.Când datele de intrare intră într-o rețea neuronală, valorile sunt înmulțite cu valorile de greutate stocate și apoi adăugate împreună pentru a genera noi rezultate.Acest proces se repetă continuu pe mai multe straturi ale rețelei neuronale.

NPU-urile moderne conțin adesea sute sau mii de unități MAC care funcționează simultan.În loc să calculeze o operație la un moment dat, hardware-ul distribuie sarcinile de lucru pe mai multe căi de execuție paralele.Loturi mari de date AI se deplasează împreună prin procesor, îmbunătățind considerabil viteza de inferență, menținând în același timp latența scăzută.În sistemele de recunoaștere a imaginilor, de exemplu, unitățile MAC scanează în mod repetat grupuri de pixeli și combină valorile filtrului pentru a detecta margini, texturi, forme și modele.În modelele de limbaj, același hardware efectuează operații vectoriale și matrice la scară mare pentru a procesa jetoane și relațiile dintre cuvinte.

După ce aceste calcule matematice sunt finalizate, rezultatele se mută în modulul Funcție de activare.Rețelele neuronale depind de funcțiile de activare neliniare pentru a procesa relații complexe în cadrul datelor.Fără procesarea activării, rețeaua ar efectua doar calcule liniare simple și nu ar putea gestiona eficient sarcinile avansate de IA.

Acest modul execută funcții precum ReLU, Sigmoid și Tanh direct în hardware.Valorile primite sunt transformate rapid în conformitate cu regula de activare selectată.ReLU, de exemplu, elimină valorile negative, păstrând în același timp ieșirile pozitive, ajutând rețeaua să se concentreze asupra semnalelor caracteristice mai puternice în timpul inferenței.Deoarece procesarea activării are loc în mod repetat în fiecare nivel al rețelei neuronale, hardware-ul dedicat de accelerare ajută la reducerea întârzierilor și previne supraîncărcarea unităților de calcul principale.

Module tensor și de prelucrare a datelor spațiale

NPU-urile includ, de asemenea, hardware specializat pentru gestionarea operațiunilor de tensor și procesarea datelor spațiale.Aproape fiecare model AI modern se bazează pe tensori, care sunt structuri de date multidimensionale utilizate pentru a organiza informațiile pe dimensiuni precum lățime, înălțime, canale, straturi de caracteristici și loturi.Cantități mari de date tensoare se deplasează continuu între straturile rețelei neuronale în timpul inferenței.

Unitatea de accelerare a tensorii procesează aceste structuri tensoare direct în hardware.Operațiuni precum multiplicarea tensorilor, remodelarea, transformarea și acumularea se execută mult mai rapid decât la procesoarele de uz general.Această accelerare dedicată devine deosebit de importantă în arhitecturile transformatoarelor, sistemele de viziune computerizată, modelele de limbaj mari și aplicațiile AI în timp real care necesită un debit foarte mare.

Pe lângă procesarea tensorială, NPU-urile conțin și module concepute pentru operațiuni 2D și date spațiale utilizate în mod obișnuit în sarcinile de lucru cu imagini și video.Sistemele de viziune computerizată redimensionează, reorganizează, filtrează și mută în mod constant cantități mari de date de pixeli înainte de a începe o analiză AI mai profundă.Gestionarea separată a acestor sarcini îmbunătățește eficiența și reduce presiunea asupra motorului de calcul principal.

În timpul procesării imaginii, hardware-ul gestionează operațiuni precum eșantionarea, mișcarea hărții caracteristicilor, copierea imaginii, redimensionarea, decuparea și transferul de date spațiale.De exemplu, videoclipurile de înaltă rezoluție capturate de o cameră pot fi mai întâi redimensionate și reorganizate înainte de a intra în conducta rețelei neuronale.Acest lucru reduce sarcina de calcul, păstrând în același timp informațiile vizuale importante necesare pentru detectarea obiectelor și analiza scenei.

Module de optimizare a memoriei și comprimare a datelor

Modelele moderne de AI necesită cantități mari de memorie pentru a stoca greutățile rețelei neuronale, tensorii și datele intermediare.Transferul constant a acestor informații între memorie și hardware de calcul crește utilizarea lățimii de bandă, latența și consumul de energie.Pentru a reduce această suprasarcină, NPU-urile includ module dedicate de compresie și decompresie a datelor.

Înainte ca datele să fie stocate în memorie, modelele repetate și valorile greutății sunt comprimate în formate mai mici.În timpul execuției, informațiile comprimate sunt rapid restaurate și trimise direct în conducta de calcul.Acest lucru reduce traficul de memorie și permite ca mai multe date AI să rămână în memoria locală de mare viteză mai aproape de procesor.

Metodele avansate de compresie pot reduce adesea dimensiunea modelului de mai multe ori, păstrând în același timp aproape aceeași precizie de inferență.Acest lucru devine deosebit de important în smartphone-uri, sisteme încorporate, camere inteligente, electronice portabile și alte dispozitive AI de vârf, unde capacitatea de memorie și eficiența energetică sunt limitate.

Cum funcționează împreună aceste module

Performanța unui NPU nu se bazează pe un singur bloc hardware.Eficiența sa provine din modul în care toate modulele de procesare funcționează împreună ca o conductă coordonată.

O sarcină de lucru tipică AI începe cu calcule matematice la scară largă în interiorul unităților MAC.Rezultatele intermediare trec apoi prin procesarea de activare pentru a introduce un comportament neliniar în rețeaua neuronală.Hardware-ul de accelerare Tensor organizează și prelucrează în mod continuu datele multidimensionale de-a lungul conductei, în timp ce modulele de procesare spațială gestionează operațiunile legate de imagini și video.În același timp, hardware-ul de compresie reduce supraîncărcarea transferului de memorie în fundal.

Deoarece aceste operațiuni rulează simultan pe căi hardware dedicate, NPU poate procesa încărcături mari de lucru AI cu debit mare, latență mai mică și eficiență energetică mult mai bună decât procesoarele tradiționale.

NPU în smartphone-uri și Mobile AI

Smartphone-urile moderne gestionează un număr masiv de operațiuni în fiecare secundă.Un telefon se poate debloca cu recunoașterea facială, deschide camera, procesa fotografii, traduce vorbirea și rulează aplicații asistate de AI aproape instantaneu.Pentru a susține acest nivel de performanță în interiorul dispozitivelor mobile subțiri cu capacitate limitată a bateriei, smartphone-urile se bazează pe arhitecturi System-on-Chip (SoC) foarte integrate.

În interiorul SoC, mai multe procesoare lucrează împreună, iar fiecare procesor este optimizat pentru o sarcină de lucru diferită.CPU gestionează controlul sistemului, aplicațiile și sarcinile generale de calcul.GPU-ul se ocupă de redarea grafică, jocurile și procesarea vizuală.NPU (Unitatea de procesare neuronală) se concentrează în mod special pe calculul AI.

În loc să direcționeze încărcăturile de lucru ale rețelei neuronale prin CPU sau GPU, smartphone-urile direcționează multe sarcini AI către NPU, unde hardware-ul este optimizat pentru procesare paralelă rapidă AI.Această separare îmbunătățește eficiența deoarece fiecare procesor se ocupă de tipul de sarcină de lucru pentru care a fost proiectat.Ca rezultat, smartphone-urile pot efectua operațiuni avansate AI cu timpi de răspuns mai rapizi, latență mai mică și eficiență energetică mai bună.

Cum au schimbat NPU-urile AI pentru smartphone

Înainte ca NPU-urile mobile să devină obișnuite, multe funcții de inteligență artificială pentru smartphone-uri depindeau în mare măsură de cloud computing.Activități precum recunoașterea vocii, traducerea limbii, îmbunătățirea imaginii și asistenții inteligenți necesitau adesea încărcarea datelor pe servere la distanță pentru procesare înainte ca rezultatele să fie returnate pe dispozitiv.Acest lucru a creat întârzieri, a crescut traficul în rețea și a ridicat probleme de confidențialitate.

Introducerea NPU-urilor mobile dedicate a schimbat acest flux de lucru în mod semnificativ.Modelele AI ar putea rula acum direct pe smartphone-ul însuși, permițând multor operațiuni să se execute local în timp real, în loc să depindă în totalitate de servere externe.

Această schimbare a oferit câteva avantaje majore:

• Latență mai mică, deoarece datele nu mai au nevoie de comunicare constantă în cloud

• Timpi de răspuns AI mai rapid în timpul operațiunilor în timp real

• O mai bună protecție a confidențialității, deoarece datele sensibile pot rămâne pe dispozitiv

• Consum redus de energie prin hardware optimizat special pentru sarcinile de lucru AI

• Performanță AI mai stabilă chiar și cu conexiuni la internet slabe sau indisponibile

Pe măsură ce NPU-urile mobile au devenit mai puternice, smartphone-urile au început să ruleze funcții AI avansate în fundal, fără întârzieri vizibile în timpul utilizării zilnice.

Cum folosesc telefoanele inteligente NPU-urile în operațiuni reale

Fotografie AI și procesare a imaginilor

Una dintre cele mai vizibile utilizări ale NPU-urilor mobile este fotografia AI.Camerele moderne pentru smartphone-uri nu se mai bazează doar pe senzori de imagine și pe algoritmi tradiționali de procesare a imaginii.Modelele AI analizează acum datele de imagine în mod continuu în timp ce camera funcționează.

Când se deschide aplicația pentru cameră, smartphone-ul începe imediat să proceseze fluxul de imagini primit cadru cu cadru.NPU analizează condițiile de iluminare, limitele obiectelor, detaliile feței, culorile, texturile și modelele de mișcare în timp real.Pe baza acestei analize, sistemul ajustează expunerea, balansul de alb, setările HDR, claritatea și contrastul aproape instantaneu înainte ca imaginea să fie capturată.

În fotografia cu lumină scăzută, NPU combină mai multe cadre de imagine împreună pentru a îmbunătăți luminozitatea, reducând în același timp zgomotul vizual.În timpul fotografierii portretelor, procesorul separă subiectele din prim plan de zonele de fundal și aplică efectele de adâncime mai precis în jurul marginilor, cum ar fi părul, ochelarii și contururile îmbrăcămintei.

Recunoașterea scenei depinde, de asemenea, în mare măsură de NPU.Procesorul compară modelele de imagine cu modelele AI antrenate pentru a identifica medii precum alimente, peisaje, animale de companie, documente, apusuri sau scene de noapte.Odată recunoscută, camera ajustează automat setările pentru a optimiza calitatea imaginii.

Deoarece aceste calcule apar direct pe smartphone, fotografia AI pare aproape instantanee, chiar dacă cantități mari de calcule ale rețelei neuronale au loc continuu în fundal.

Recunoaștere vocală și asistenți AI

Asistenții vocali și funcțiile legate de vorbire se bazează, de asemenea, în mare măsură pe accelerarea AI locală.Când un utilizator vorbește cu smartphone-ul, microfonul captează semnale audio brute care trebuie curățate, separate și convertite în modele de vorbire recunoscute.

NPU procesează continuu fluxul audio prin identificarea fonemelor, filtrarea zgomotului de fundal și potrivirea modelelor de sunet cu modelele de recunoaștere a vorbirii.Procesarea locală AI permite ca cuvintele de trezire și comenzile vocale comune să fie detectate aproape instantaneu, fără a transmite în mod constant înregistrările audio către serverele cloud.

Acest lucru îmbunătățește capacitatea de răspuns la sarcini precum:

• Comenzi vocale

• Transcrierea vorbirii în timp real

• Traducerea limbii

• Interacțiunea asistentului AI

• Îmbunătățirea apelurilor AI

• Suprimarea zgomotului în timpul apelurilor video

Deoarece o mare parte din procesare are loc direct pe dispozitiv, interacțiunea vocală rămâne mai lină chiar și în condiții instabile de rețea.

AI Gaming și optimizarea sistemului în timp real

Smartphone-urile moderne folosesc, de asemenea, NPU-uri pentru optimizarea jocurilor și gestionarea inteligentă a sistemului.În timpul jocului, modelele AI monitorizează cererea de redare a cadrelor, comportamentul sarcinii de lucru, condițiile termice, modelele de introducere la atingere și utilizarea bateriei în timp real.

Sistemul poate ajusta dinamic sarcinile de lucru GPU, poate optimiza alocarea energiei, poate stabiliza ratele de cadre și poate reduce supraîncălzirea în timpul sesiunilor lungi de joc.Unele smartphone-uri folosesc, de asemenea, tehnici de upscaling AI și de predicție a mișcării pentru a îmbunătăți netezimea vizuală, menținând în același timp un consum mai mic de energie.

În afara jocurilor, NPU ajută la optimizarea aplicațiilor de fundal, gestionarea bateriei, interacțiunile predictive cu utilizatorul și programarea sarcinilor pe baza modelelor de utilizare a dispozitivului.

Evoluția NPU-urilor mobile

Dezvoltarea NPU-urilor mobile s-a accelerat rapid pe măsură ce sarcinile de lucru AI pentru smartphone-uri au devenit mai avansate și mai solicitante din punct de vedere informatic.

|

Perioada |

Dezvoltare NPU mobil |

|

2017 — NPU-uri mobile comerciale timpurii |

Huawei a introdus unul dintre primele smartphone-uri comerciale

NPU-uri prin procesorul Kirin 970.Aceasta a marcat o schimbare majoră către

accelerare pe scară largă a IA pe dispozitiv în interiorul smartphone-urilor pentru consumatori.În loc de

bazându-se în principal pe procesoare și GPU-uri pentru sarcini AI, smartphone-uri incluse acum

hardware AI dedicat direct în arhitectura SoC. |

|

2018 — Expansion of On-Device AI |

Apple a introdus Neural Engine în interiorul A12 Bionic

cip, îmbunătățirea procesării AI pentru recunoașterea facială, computațional

fotografie și funcții mobile inteligente.Inteligența artificială pe dispozitiv a devenit o importanță majoră

concentrare pe dezvoltarea de smartphone-uri emblematice. |

|

2019–2020 — Integrare AI la nivel de industrie |

Principalii producători de cipuri, inclusiv Qualcomm, Samsung și

MediaTek a început să integreze acceleratoare AI dedicate în mobilul emblematic

procesoare.Performanța AI a început să devină un factor competitiv major în

design hardware pentru smartphone. |

|

2021–2023 — Procesarea AI devine un punct de referință de bază |

Producătorii de smartphone-uri au comparat din ce în ce mai mult NPU

performanță alături de performanța CPU și GPU.NPU-urile au devenit esențiale pentru

fotografie computațională, AI vocală, îmbunătățire video, optimizare a bateriei,

și caracteristici ale sistemului inteligent. |

|

2024–2025 — Modele mari AI care rulează pe telefoane inteligente |

NPU-urile mobile moderne au câștigat suficientă putere de procesare pentru

acceptă modele AI mai mari direct pe smartphone-uri și dispozitive edge.Mai mult AI

încărcăturile de lucru ar putea rula acum local, fără a depinde foarte mult de cloud

infrastructură, îmbunătățind atât capacitatea de răspuns, cât și confidențialitatea. |

Comparație dintre NPU-urile mobile mainstream actuale

Procesoarele moderne de smartphone-uri de vârf includ acum arhitecturi NPU foarte avansate, optimizate pentru inferență AI în timp real, debit mare și eficiență energetică îmbunătățită.

|

Procesor mobil |

Caracteristici NPU |

|

Apple A17 Pro |

Include un motor neuronal cu 26 de nuclee conceput pentru rapiditate

procesare AI pe dispozitiv.Arhitectura îmbunătățește fotografia AI, vocea

recunoaștere și caracteristici ale sistemului inteligent în timp real pe dispozitivele Apple. |

|

Qualcomm Snapdragon 8 Gen 3 |

Utilizează un procesor Hexagon AI modernizat, optimizat pentru

IA generativă, accelerarea rețelei neuronale, procesarea avansată a imaginilor și

încărcături de lucru eficiente mobile AI. |

|

MediaTek Dimensity 9300 |

Include o a șasea generație APU (AI Processing Unit) cu

îmbunătățiri majore ale vitezei de inferență AI și procesării AI în timp real

capacitate pentru smartphone-uri și dispozitive edge. |

|

Samsung Exynos 2400 |

Dispune de un NPU mobil de ultimă generație axat pe mai rapid

procesare AI pe dispozitiv pentru fotografie computațională, sistem inteligent

operațiuni și aplicații mobile avansate AI. |

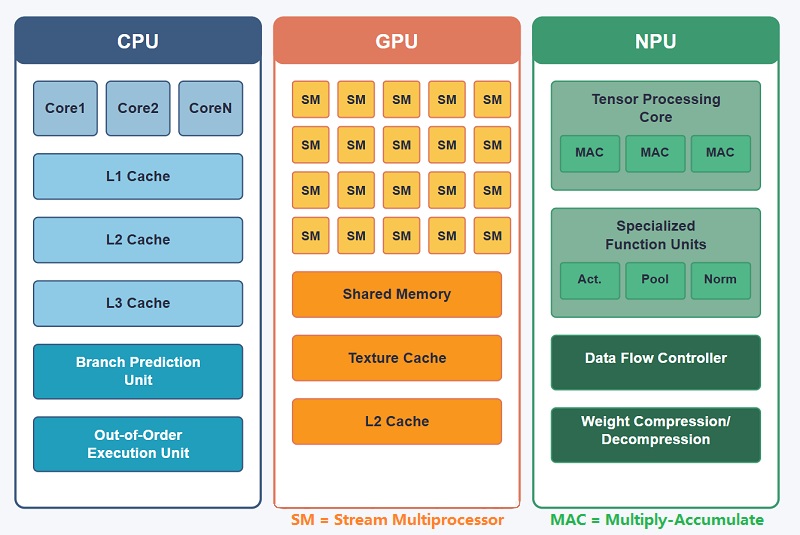

NPU vs GPU vs CPU: diferențe cheie în procesarea AI

Atât GPU-urile, cât și NPU-urile sunt concepute pentru a procesa cantități mari de date în paralel, dar au fost construite în scopuri foarte diferite.Un GPU a fost dezvoltat inițial pentru redarea grafică, în timp ce un NPU a fost creat special pentru calculul rețelelor neuronale și inferența AI. Din cauza acestei diferențe în obiectivele de proiectare, cele două procesoare gestionează sarcinile de lucru AI în moduri foarte diferite.GPU-urile pot rula modele AI în mod eficient, în special în sistemele de antrenament la scară largă, dar încă poartă o mare parte din complexitatea unui procesor grafic.NPU-urile simplifică multe dintre aceste operațiuni concentrându-se aproape în întregime pe calculele legate de AI.

|

Caracteristică |

CPU

(Unitate centrală de procesare) |

GPU

(Unitate de procesare grafică) |

NPU

(Unitate de procesare neuronală) |

|

Scopul principal |

De uz general

calcularea și controlul sistemului |

Paralel

grafică și calcul de înaltă performanță |

Inferența AI și

accelerarea rețelei neuronale |

|

Sarcina de lucru primară |

Funcționează

sisteme, aplicații, multitasking |

Grafică

randare, instruire AI, calcul științific |

procesare AI,

operații tensoare, inferență de învățare profundă |

|

Stilul de procesare |

Secvenţial

prelucrare |

Paralela masivă

prelucrare |

optimizat pentru AI

prelucrare paralelă |

|

Core Design |

Puțini puternici și

miezuri flexibile |

Mii de

nuclee de execuție paralele |

AI specializat

unități de accelerație |

|

Performanța AI |

Moderat |

Înalt |

Foarte ridicat pentru AI

deducere |

|

Matrice

Viteza de multiplicare |

Limitat |

Rapid |

Foarte optimizat |

|

Tensor

Prelucrare |

Bazat pe software |

Sprijinit

prin accelerarea GPU |

Tensor dedicat

hardware de accelerare |

|

Eficiență energetică |

Mai jos pentru AI

sarcinile de lucru |

Moderat spre ridicat

consumul de energie |

Putere mare

eficient |

|

Generare de căldură |

Moderat |

Mare sub grea

sarcinile de lucru |

Scădeți în timpul AI

deducere |

|

Lățimea de bandă a memoriei

Utilizare |

Moderat |

Foarte sus |

Optimizat și

redus |

|

Latența în AI

Sarcini |

Mai sus |

Moderat |

Foarte scăzut |

|

AI în timp real

Capacitate |

Limitat |

Bun |

Excelent |

|

Cel mai bun pentru AI

Antrenamentul |

Nu este ideal |

Excelent |

Limitat comparativ

la GPU-uri |

|

Cel mai bun pentru AI

Inferență |

Sarcini de lucru de bază |

De înaltă performanță

deducere |

Optimizat

inferență în timp real |

|

comună

Aplicații |

PC-uri, servere,

sisteme de operare |

Jocuri, AI

antrenament, randare, simulări |

telefoane inteligente,

AI de vârf, robotică, camere inteligente |

|

Dependenta de

Cloud AI |

Mai sus |

Moderat |

Mai jos din cauza

accelerarea AI locală |

|

Bateria

Eficiență în dispozitivele mobile |

Mai jos |

Moderat |

Înalt |

|

Dispozitive tipice |

calculatoare,

laptopuri, servere |

PC-uri pentru jocuri, AI

servere, stații de lucru |

Smartphone-uri, IoT

dispozitive, hardware AI de vârf |

|

Costul și

Complexitatea |

De uz general

arhitectura |

Complex

arhitectura performanta |

Specializat

Arhitectură axată pe AI |

|

Avantajul principal |

Flexibilitate și

managementul sistemului |

La scară largă

calcul paralel |

Rapid și

procesare AI locală eficientă |

Unități de procesare specializate în calculul modern

În afară de NPU, sistemele de calcul moderne folosesc multe tipuri diferite de procesoare, deoarece nicio arhitectură nu poate gestiona eficient fiecare sarcină de lucru.Unele procesoare se concentrează pe controlul sistemului, unele sunt specializate în redarea grafică, în timp ce altele sunt optimizate pentru accelerarea AI, crearea de rețele, calculul științific sau controlul încorporat.

În interiorul smartphone-urilor moderne, serverelor, sistemelor industriale, platformelor robotice, vehiculelor și dispozitivelor AI de vârf, mai multe unități de procesare lucrează adesea împreună simultan.Fiecare procesor se ocupă de tipul de sarcină de lucru pentru care a fost special conceput, îmbunătățind performanța, eficiența energetică și capacitatea de răspuns în timp real în mediile de calcul moderne.

CPU: Unitate centrală de procesare

Un procesor (Central Processing Unit) este controlerul principal al majorității sistemelor de calcul.Gestionează sistemele de operare, aplicațiile, coordonarea memoriei, programarea sarcinilor și comunicarea între componentele hardware.

Procesoarele sunt extrem de flexibile și pot gestiona multe sarcini de lucru diferite în mod fiabil, făcându-le esențiale în computere, smartphone-uri, servere și sisteme încorporate.Cu toate acestea, ele sunt mai puțin eficiente pentru sarcinile de lucru AI paralele la scară largă în comparație cu procesoarele mai specializate.

GPU: Unitate de procesare grafică

Un GPU (Graphics Processing Unit) este optimizat pentru procesarea paralelă la scară largă.Arhitectura conține multe nuclee de execuție capabile să gestioneze mii de operațiuni simultan.

GPU-urile au fost dezvoltate inițial pentru redarea grafică, dar acum sunt utilizate pe scară largă pentru instruire AI, simulare științifică, procesare video și calcul de înaltă performanță, datorită capacității lor puternice de calcul paralel.

TPU: Unitate de procesare a tensorului

Un TPU (Tensor Processing Unit) este optimizat pentru sarcinile de lucru AI bazate pe tensori și accelerarea învățării profunde la scară largă.Aceste procesoare sunt proiectate în principal pentru infrastructura cloud AI și medii de învățare automată a centrelor de date.

TPU-urile sunt foarte eficiente pentru:

• Antrenamentul de deep learning

• Modele mari AI

• Calcul tensor

• Servicii cloud AI

• Accelerare AI de mare randament

FPGA: Procesare hardware reconfigurabilă

Un FPGA (Field-Programmable Gate Array) folosește blocuri logice programabile care pot fi configurate pentru sarcini specifice după fabricație.Spre deosebire de arhitecturile cu procesoare fixe, FPGA-urile permit personalizarea funcției hardware în sine.

FPGA-urile sunt utilizate pe scară largă în:

• Sisteme de comunicare

• Electronice auto

• Automatizări industriale

• Sisteme aerospațiale

• Edge computing

• Dispozitive medicale

DPU: Unitatea de procesare a datelor

O DPU (Unitate de procesare a datelor) este optimizată pentru sarcinile de lucru centrate pe date din infrastructura cloud și sistemele de rețea.DPU-urile ajută la reducerea sarcinii de lucru ale procesorului prin accelerarea mișcării datelor, a operațiunilor de stocare, a criptării și a gestionării traficului de rețea.

Aceste procesoare sunt utilizate în mod obișnuit în:

• Centre de date

• Cloud computing

• Rețea de mare viteză

• Accelerarea stocării

• Infrastructura serverului

VPU: Unitate de procesare a vederii

Un VPU (Vision Processing Unit) este specializat în viziune computerizată și procesare AI bazată pe imagini.VPU-urile accelerează sarcinile de lucru, cum ar fi recunoașterea facială, detectarea obiectelor, urmărirea mișcării și analiza video.

VPU-urile se găsesc frecvent în:

• Camere inteligente

• Sisteme de supraveghere

• Robotică

• Vehicule autonome

• Sisteme AR/VR

• Dispozitive de viziune Edge AI

IPU: Unitatea de procesare a informațiilor

O IPU (Intelligence Processing Unit) este proiectată pentru sarcini de lucru extrem de paralele AI și învățare automată.Arhitectura se concentrează pe îmbunătățirea eficienței fluxului de date în timpul execuției rețelelor neuronale la scară largă.

IPU-urile sunt utilizate pentru:

• Accelerarea învățării automate

• Recunoașterea modelelor

• Inferența AI

• Prelucrare paralelă a tensorilor

• Cercetare avansată AI

BPU: Unitatea de procesare a creierului

Un BPU (Brain Processing Unit) este optimizat pentru AI încorporat și sisteme de inteligență edge.Aceste procesoare se concentrează pe inferența locală rapidă AI cu un consum mai mic de energie.

BPU-urile sunt utilizate în mod obișnuit în:

• Sisteme inteligente de detectare

• Robotică

• Hardware Edge AI

• Sisteme de detectare a mișcării

• Platforme autonome

HPU: Unitate de procesare holografică

Un HPU (Holographic Processing Unit) este proiectat pentru sisteme de calcul holografice, realitate mixtă și analiză spațială.

HPU-urile ajută la procesarea:

• Hartizarea mediului

• Urmărirea mișcării

• Fuziunea senzorilor

• Interacțiune spațială în timp real

• Medii AR/VR

MPU și MCU: Procesare de control încorporat

MPU-urile (Microprocessor Units) și MCU-urile (Microcontroller Units) sunt utilizate pe scară largă în sistemele încorporate și în electronica de mică putere.

MPU-urile sunt utilizate în mod obișnuit în sistemele de calcul încorporate care necesită control la nivel de sistem de operare, în timp ce MCU-urile integrează nuclee de procesor, memorie și control de intrare/ieșire într-un cip compact pentru sarcini dedicate cu consum redus.

Aceste procesoare se găsesc în mod obișnuit în:

• Dispozitive IoT

• Controlere industriale

• Electronice auto

• Electrocasnice

• Sisteme încorporate portabile

APU: Unitate de procesare accelerată

Un APU (Unitate de procesare accelerată) combină funcționalitatea CPU și GPU într-un singur pachet de procesor.Această integrare îmbunătățește eficiența energetică, reduce dimensiunea hardware-ului și permite sarcinilor de lucru de calcul și grafică să partajeze resursele sistemului mai eficient.

APU-urile sunt utilizate în mod obișnuit în:

• Laptop-uri

• Mini PC-uri

• Sisteme de jocuri entry-level

• Dispozitive multimedia

• Platforme de calcul portabile

De ce sistemele moderne folosesc mai multe procesoare specializate

Sistemele de calcul moderne se bazează rar pe o arhitectură cu un singur procesor.În schimb, dispozitivele combină mai multe procesoare specializate împreună, deoarece sarcinile de lucru diferite necesită metode de procesare diferite.

De exemplu, un sistem modern poate folosi:

• CPU pentru controlul sistemului

• GPU-uri pentru grafică și calcul paralel

• NPU pentru inferența AI

• VPU-uri pentru viziune computerizată

• DPU pentru rețea și mișcarea datelor

• MCU-uri pentru sarcini de control încorporate

Prin distribuirea sarcinilor de lucru pe hardware-ul dedicat, sistemele moderne obțin performanțe mai bune, latență mai mică, eficiență energetică îmbunătățită și procesare în timp real mai eficientă în mediile AI, grafică, rețele și de calcul încorporat.

Concluzie

NPU-urile devin esențiale în calculul modern, deoarece permit sarcinilor AI să ruleze local, rapid și eficient, fără a depinde foarte mult de procesarea în cloud.Arhitectura lor optimizată reduce latența, utilizarea energiei, mișcarea memoriei și generarea de căldură, făcându-le valoroase în smartphone-uri, robotică, dispozitive de îngrijire a sănătății, automatizări industriale, case inteligente, sisteme autonome și platforme AI de vârf.Pe măsură ce modelele AI devin din ce în ce mai mari și mai complexe, viitoarele NPU-uri vor continua să se îmbunătățească prin arhitecturi mai inteligente, calcul cu precizie scăzută, procesare în memorie, suport local pentru modele mari, design avansat de semiconductor și funcții de securitate AI mai puternice.

Întrebări frecvente [FAQ]

1. De ce sunt NPU-urile mai eficiente decât CPU-urile pentru sarcinile de lucru ale rețelelor neuronale?

NPU-urile sunt mai eficiente, deoarece hardware-ul lor este proiectat special pentru calculul AI în loc de procesare de uz general.Un procesor gestionează secvențial multe sarcini de sistem diferite, în timp ce un NPU se concentrează în principal pe operațiunile tensorilor, multiplicarea matricei, convoluția și procesarea rețelelor neuronale paralele.Acest lucru permite NPU-urilor să completeze inferența AI mai rapid, folosind mai puțină energie și generând mai puțină căldură.

2. Cum îmbunătățește procesarea paralelă performanța NPU în timpul inferenței AI?

NPU-urile împart sarcinile de lucru AI în multe operațiuni mai mici care rulează simultan pe mai multe unități de calcul.În loc să așteptați ca o instrucțiune să se termine înainte de a începe alta, cantități mari de date ale rețelei neuronale se deplasează prin procesor în paralel.Acest lucru îmbunătățește semnificativ debitul și reduce latența în timpul sarcinilor de lucru, cum ar fi recunoașterea imaginilor, procesarea vorbirii și detectarea obiectelor în timp real.

3. De ce este importantă calcularea cu precizie scăzută în NPU-urile moderne?

Multe modele AI nu necesită o precizie numerică extrem de mare pentru a produce rezultate precise.NPU-urile folosesc formate precum INT8 și FP16 pentru a reduce utilizarea memoriei și supraîncărcarea de calcul.Prelucrarea cu precizie mai scăzută permite finalizarea mai multor operațiuni în mai puțin timp, îmbunătățind în același timp eficiența energetică și menținând o performanță puternică a inferenței AI.

4. Cum reduc NPU-urile blocajele de transfer de memorie în comparație cu GPU-urile?

NPU-urile plasează memoria și hardware-ul de calcul mai aproape unul de celălalt în interiorul arhitecturii procesorului.În loc să transfere în mod repetat cantități mari de date tensoare între memoria externă și nucleele de procesare, multe operații intermediare rămân în apropierea unităților de execuție.Acest lucru scurtează căile de date, reduce utilizarea lățimii de bandă, scade latența și îmbunătățește eficiența generală a energiei.

5. De ce devin NPU-urile utile în smartphone-uri și dispozitive AI de vârf?

Dispozitivele moderne necesită procesare AI locală rapidă, cu un consum redus de energie și o latență minimă.NPU-urile permit smartphone-urilor și sistemelor de vârf să efectueze sarcini AI, cum ar fi recunoașterea facială, fotografia AI, interacțiunea vocală și detectarea obiectelor direct pe dispozitiv, fără a depinde foarte mult de serverele cloud.Acest lucru îmbunătățește capacitatea de răspuns, confidențialitatea și eficiența bateriei.

6. Cum contribuie unitățile MAC la accelerarea NPU?

Unitățile de multiplicare-acumulare (MAC) gestionează operațiunile repetate de înmulțire și adunare utilizate în rețelele neuronale.NPU-urile moderne conțin sute sau mii de unități MAC care funcționează simultan, permițând procesării mari de lucru AI mult mai rapid decât pe procesoarele secvențiale tradiționale.

7. De ce sistemele AI moderne folosesc atât GPU-uri, cât și NPU-uri în loc să se bazeze pe un singur tip de procesor?

GPU-urile și NPU-urile sunt optimizate pentru diferite sarcini de lucru.GPU-urile excelează la instruirea AI la scară largă, redarea grafică și calculul paralel de înaltă performanță, în timp ce NPU-urile sunt optimizate pentru inferență AI de putere redusă și procesare locală în timp real.Utilizarea ambelor procesoare împreună permite sistemelor să echilibreze flexibilitatea, performanța și eficiența energetică.

8. Cum îmbunătățesc NPU-urile procesarea AI în timp real în robotică și sisteme autonome?

Robotica și sistemele autonome procesează continuu intrarea camerei, cartografierea mediului, datele senzorilor și analiza mișcării.NPU-urile accelerează aceste sarcini la nivel local cu o latență scăzută, permițând sistemelor să reacționeze rapid în timpul navigării, detectării obstacolelor, recunoașterii pietonilor și luării deciziilor în timp real.

9. De ce AI pe dispozitiv devine mai importantă pentru dezvoltarea viitoare a NPU?

AI pe dispozitiv reduce dependența de cloud computing, permițând modelelor AI să ruleze direct pe hardware-ul local.Acest lucru îmbunătățește confidențialitatea, reduce utilizarea lățimii de bandă a rețelei și permite răspunsuri mai rapide în timp real.Se așteaptă ca viitoarele NPU să accepte modele AI locale mai mari, procesare multimodală AI și sarcini de lucru AI generative avansate direct în interiorul dispozitivelor de consum și industriale.

10. Cum ar putea viitoarele arhitecturi NPU să schimbe eficiența hardware-ului AI?

Viitoarele NPU-uri vor folosi probabil o alocare mai inteligentă a sarcinii de lucru, calcule rare, procesare în memorie, arhitecturi chiplet și control adaptiv de precizie pentru a îmbunătăți eficiența.Aceste tehnologii urmăresc să reducă calculele inutile, un consum mai mic de energie și să mărească debitul, susținând în același timp modele AI mai mari și mai avansate pentru dispozitive de vârf, robotică, sisteme industriale și electronice inteligente de consum.

Blog înrudit

-

Câte zerouri într -un milion, miliarde, trilioane?

2024/07/29

Milioane reprezintă 106, o cifră ușor de înțeles în comparație cu articolele de zi cu zi sau cu salariile anuale. Miliarde, echivalent cu 109, ... -

Fisa de date IRLZ44N MOSFET, circuit, echivalent, pinout

2024/08/28

IRLZ44N este un MOSFET de canal N-canal utilizat pe scară largă.Renumit pentru capacitățile sale excelente de comutare, este foarte potrivit pentr... -

Temperatura bateriei prea scăzută, încărcarea s -a oprit.Cum să -l rezolvi?

2024/10/6

Problemele de încărcare a bateriei pentru telefonul mobil sunt comune, dar pot fi gestionate eficient.Temperatura joacă un rol important în eficie... -

BC547 Ghid cuprinzător al tranzistorului

2024/07/4

Tranzistorul BC547 este utilizat în mod obișnuit într -o varietate de aplicații electronice, de la amplificatoare de semnal de bază la circuite o... -

Ghid cuprinzător pentru SCR (redresor controlat de siliciu)

2024/04/22

Redarele controlate de siliciu (SCR) sau tiristori joacă un rol pivot în tehnologia electronică a puterii, datorită performanței și fiabilităț... -

LR621, SR621SW, 364, AG1 Echivalenți și înlocuitori ai bateriei AG1

2024/07/15

Bateriile cu butoane LR621 și SR621SW sunt predominante în dispozitive electronice compacte, precum ceasuri, jucării mici, calculatoare și tastele... -

Fundamentele circuitelor Op-Amp

2023/12/28

În lumea complexă a electronicelor, o călătorie în misterele sale ne conduce invariabil la un caleidoscop al componentelor circuitului, atât raf... -

Compararea diferențelor și aplicațiilor NMOS și PMOS

2024/11/15

Înțelegerea diferențelor dintre tranzistoarele NMOS și PMOS este importantă în proiectarea circuitelor eficiente.NMOS (N-Type Metal-Oxid-Semomon... -

Un ghid complet pentru multiplexori și rolul lor în sistemele digitale

2025/09/20

Multiplexoarele sunt componente în sisteme digitale, concepute pentru a canaliza semnale de intrare multiple într -o singură linie de ieșire folos... -

Ce înseamnă STD, AGM și Gel pe un încărcător de baterii

2024/07/10

Încărcătoarele tradiționale de baterii cu plumb sunt cunoscute pentru simplitatea și fiabilitatea lor.Își îndeplinesc scopul în mod eficient ...

Piese Hot

- GRM0225C1E1R7CA03L

- LT1767EMS8E-1.8

- 5AGXFB3H4F35C5N

- CS5341DZZ

- QVS212CG560JDHT

- STV7617D

- AD8041ARZ-REEL7

- M29W400BB-70N1

- NB4L6254FAG

- TC59LM818DMB-33

- T110A105M035AT

- 18123C684JAT2A

- CL21C220JBANFNC

- TNPW08052K94BEEA

- IPD30N06S2L-13

- LQM18NN2R2K00D

- ATF1504ASL-25AU100

- TS8121KHF

- PI2B4300LX

- MIC2941AWU-TR

- ST70138B

- MR25H10CDF

- 12061C122JAZ2A

- LTC2944CDD#TRPBF

- 12065A332GAT2A

- MAX4895EETE+T

- XC5VTX150T-2FFG1759C

- MT46H32M32LFB5-6AT:B

- M430U133SI

- CC0805JRNPOYBN101

- AD5222BR10

- SG3525AP013TR

- IXBH16N170

- TL1464IPTR

- MPC8313CVRADDB

- REG8B21L03U1033

- T499A334K035ATE15K

- VI-251-CW

- T491B107K006ZT

- S29AL016J70BFI022

- AD9173BBPZ

- T491C106M016AT4280

- EFB0512HA

- HY534256ALJ-45

- QM14002TR13

- ROP1011114/CR1/DM5950HL

- XCF16PVO48

- MSD306PT-LF-SG

- PEF42065V1.1

- H5AN4G6NBJR-TFC